Minggu lalu, ada klien ecommerce fashion di Jakarta yang menghubungi saya dengan keluhan yang cukup familiar: “Mas Ahmad, produk baru kami sudah seminggu dipublish, tapi kenapa belum muncul di Google? Padahal produk lama yang sudah tidak dijual malah masih nongol di pencarian.”

Setelah saya cek Google Search Console mereka, ternyata masalahnya klasik: dari 50.000 URL yang ada di website, Googlebot lebih sibuk crawling ribuan halaman filter kombinasi warna-ukuran-harga yang sebenarnya tidak perlu diindex. Sementara produk baru yang penting? Baru dicrawl seminggu kemudian.

Ini adalah contoh nyata masalah crawl budget. Dan percaya atau tidak, ini adalah salah satu masalah teknis SEO yang paling sering saya temui di website Indonesia—terutama di ecommerce, marketplace, portal berita, atau katalog produk dengan ribuan halaman.

Di artikel ini, kita akan membedah tuntas apa itu crawl budget, kenapa topik ini sering disalahpahami, kapan ini jadi masalah serius (dan kapan tidak), dan yang paling penting: bagaimana cara mengoptimalkannya untuk konteks website Indonesia.

Apa Itu Crawl Budget?

Sebelum kita masuk ke strategi, mari kita luruskan dulu definisinya. Crawl budget ini sering disalahpahami sebagai “kuota harian” yang Google kasih ke setiap website. Padahal konsepnya lebih kompleks dari itu.

Definisi crawl budget (versi yang paling praktis)

Menurut Google Search Central, crawl budget adalah jumlah URL yang Googlebot bisa dan mau crawl pada sebuah website dalam periode tertentu.

Perhatikan dua kata kunci di sini: “bisa” dan “mau”. Ini penting, karena crawl budget bukan semata-mata tentang batasan teknis server kalian. Ini juga tentang apakah Google menganggap URL-URL di website kalian cukup penting untuk dicrawl.

Bayangkan Googlebot seperti seorang kurir yang punya waktu terbatas untuk mengunjungi toko-toko di sebuah mall. Dia bisa mengunjungi 100 toko dalam sehari (itu kapasitasnya). Tapi dia juga punya prioritas: toko mana yang paling sering dikunjungi pelanggan, toko mana yang sering update produk baru, dan toko mana yang responsif saat dia datang.

Nah, crawl budget dibentuk oleh dua komponen utama:

Dibentuk oleh dua komponen: crawl rate limit + crawl demand

Crawl rate limit adalah batas kemampuan crawl—seberapa cepat dan seberapa banyak Googlebot bisa mengakses website kalian tanpa membebani server. Ini dipengaruhi oleh “kesehatan” website kalian: server cepat dan stabil bisa dapat limit lebih tinggi, sementara server yang sering error atau lambat akan dapat limit lebih rendah.

Crawl demand adalah batas kebutuhan crawl—seberapa sering Google merasa perlu untuk crawl URL-URL di website kalian. Ini dipengaruhi oleh popularitas URL (URL yang sering diklik cenderung lebih sering dicrawl agar tetap fresh), staleness (Google berusaha mencegah URL jadi “basi” di index), dan event tertentu seperti migrasi website yang bisa memicu crawl demand meningkat.

Jadi crawl budget itu pertemuan antara “berapa banyak server kalian sanggup dilayani” dengan “seberapa penting Google menganggap konten kalian perlu di-refresh”.

Kapan crawl budget jadi masalah (dan kapan tidak)

Nah, ini yang sering membingungkan. Apakah setiap website perlu mikirin crawl budget?

Jawabannya: tidak semua.

Menurut dokumentasi Google, crawl budget umumnya hanya jadi masalah serius untuk website dengan karakteristik ini:

- Website besar dengan puluhan ribu hingga ratusan ribu URL

- Website yang sering update konten (misalnya portal berita yang publish 50+ artikel per hari)

- Website dengan struktur URL kompleks (ecommerce dengan banyak filter, marketplace dengan jutaan produk)

Untuk website kecil sampai menengah dengan beberapa ratus atau ribuan halaman, crawl budget biasanya bukan bottleneck utama. Kalau konten kalian tidak terindex atau ranking tidak bagus, lebih sering masalahnya ada di kualitas konten, struktur internal linking, atau technical SEO lainnya—bukan karena Google kehabisan “jatah” untuk crawl website kalian.

Tapi kalau website kalian punya 50.000+ URL dengan struktur yang rumit? Nah, ini saatnya kalian perlu serius mikirin crawl budget.

Bagaimana Googlebot “Menentukan” Crawl Budget

Mari kita bedah lebih dalam dua komponen pembentuk crawl budget tadi.

Komponen 1: Crawl Rate Limit (batas kemampuan crawl)

Crawl rate limit ini ditentukan oleh crawl health website kalian. Sederhananya: kalau server kalian cepat dan jarang error, Google bisa naikkan limit crawling. Sebaliknya, kalau server sering timeout atau kasih response error 5xx, Google akan turunkan crawl rate untuk “melindungi” server kalian.

Ini prinsip yang cukup fair sebenarnya. Google tidak mau membebani server kalian sampai down, jadi dia punya mekanisme otomatis untuk mengatur kecepatan crawling berdasarkan performa server.

Yang menarik, di Google Search Console kalian bisa menurunkan crawl rate secara manual (misalnya kalau sedang ada maintenance atau server sedang bermasalah). Tapi kalian tidak bisa memaksakan Google untuk menaikkan crawl rate—itu keputusan yang dibuat Google berdasarkan observasi performa server kalian.

Komponen 2: Crawl Demand (batas kebutuhan crawl)

Sementara itu, crawl demand ditentukan oleh beberapa faktor:

Popularity: URL yang populer—yang sering diklik dari hasil pencarian atau sering mendapat backlink—cenderung dicrawl lebih sering. Logikanya, Google mau memastikan konten populer ini tetap fresh di index.

Staleness: Google punya algoritma untuk mencegah URL jadi “basi” di index. Kalau suatu URL sudah lama tidak dicrawl, kemungkinan besar akan masuk antrian untuk dicrawl ulang.

Event tertentu: Migrasi domain, perubahan struktur website, atau update besar-besaran bisa memicu crawl demand meningkat. Ini karena Google perlu “memetakan ulang” struktur website kalian.

Jadi pada intinya, crawl demand ini dinamis dan dipengaruhi oleh seberapa “penting” dan “dinamis” konten kalian di mata Google.

“Pemborosan” Crawl Budget yang Paling Sering Terjadi

Nah, ini bagian yang paling relevan untuk banyak website Indonesia. Dari pengalaman saya menangani puluhan klien ecommerce, marketplace, dan portal, masalah crawl budget hampir selalu muncul karena hal-hal ini:

Low-value URLs yang bikin Googlebot kehabisan “jatah”

Faceted navigation / filter URLs & session IDs

Ini adalah penyebab nomor satu crawl budget “bocor” di ecommerce Indonesia. Website dengan filtering produk berdasarkan warna, ukuran, harga, brand, dan sorting bisa menghasilkan jutaan kombinasi URL.

Contoh kasusnya: website fashion dengan 1.000 produk, tapi karena ada filter warna (10 pilihan), ukuran (8 pilihan), brand (50 pilihan), dan harga (5 range), secara matematis bisa menghasilkan ratusan ribu kombinasi URL. Padahal mayoritas kombinasi ini tidak pernah dikunjungi user dan tidak perlu diindex Google.

Begitu juga dengan session ID yang di-append ke URL. Ini menciptakan URL unik untuk setiap user session, tapi kontennya identik. Pemborosan crawl budget yang sangat tidak efisien.

Duplicate content (on-site duplication)

Konten duplikat internal juga sering jadi masalah. Misalnya produk yang sama muncul di beberapa kategori dengan URL berbeda, atau artikel yang sama dipublish di multiple tag pages.

Soft error pages (soft 404, halaman tipis tapi status 200)

Ini sangat umum di ecommerce: halaman kategori yang sudah kosong (semua produk sold out) atau halaman produk yang out of stock, tapi masih mengembalikan status code 200 (OK) alih-alih 404 atau 410.

Google tetap crawl halaman-halaman ini secara regular, padahal tidak ada konten yang valuable untuk diindex.

Infinite spaces (kombinasi filter tanpa batas), proxy pages

Pagination yang tidak dibatasi juga bisa menciptakan infinite crawl loop. Atau halaman-halaman proxy yang sebenarnya tidak perlu ada tapi ter-generate otomatis oleh sistem.

Hacked/spam URLs

Kalau website pernah kena hack dan attacker membuat ribuan spam pages, Google bisa menghabiskan crawl budget untuk crawl halaman-halaman spam ini alih-alih konten legitimate kalian.

Resource & alternate URLs juga “makan” crawl budget

Ini yang sering dilupakan: bukan cuma HTML pages yang dikonsumsi oleh crawl budget.

Untuk website modern yang heavily rely on JavaScript, Googlebot perlu crawl CSS, JS, dan bahkan XHR requests untuk bisa merender halaman dengan benar. Kalau resource-resource ini berat atau banyak, konsumsi crawl budget juga meningkat.

Begitu juga dengan alternate URLs seperti AMP version atau hreflang variations—semua ini ikut terhitung saat dicrawl.

Crawl Budget vs Indexing: Jangan Ketukar

Ini mitos yang perlu saya luruskan karena sering banget saya dengar: “Kalau saya tingkatkan crawl rate, apakah ranking saya akan naik?”

Jawabannya: tidak otomatis.

Crawl ≠ index

Crawling dan indexing adalah dua tahap yang berbeda dalam proses Google. Crawling adalah tahap “pengumpulan data”—Googlebot mengunjungi halaman kalian dan mengambil kontennya. Indexing adalah tahap “penilaian dan penyimpanan”—Google memutuskan apakah konten ini worthy untuk disimpan di index dan ditampilkan di hasil pencarian.

Jadi meningkatkan crawl rate tidak otomatis meningkatkan ranking. Yang terjadi hanyalah Google lebih cepat “tahu” tentang update konten kalian. Tapi apakah konten itu worthy untuk diindex dan diranking tinggi? Itu cerita lain.

Google bisa saja crawl halaman kalian setiap hari, tapi memilih untuk tidak mengindeksnya karena konten duplikat, kualitas rendah, atau sudah ada canonical tag yang mengarah ke URL lain.

Apakah 4xx “buang-buang” crawl budget?

Ini juga mitos yang cukup menyebar. Banyak yang takut punya banyak halaman 404 karena dikira “membuang” crawl budget.

Faktanya, menurut Google, error 4xx (kecuali 429 – Too Many Requests) tidak dianggap membuang crawl budget seperti yang sering dikira. Googlebot cukup cerdas untuk mengenali bahwa halaman ini memang tidak ada, dan tidak akan terus-menerus crawl halaman yang konsisten mengembalikan 404.

Yang lebih bermasalah adalah soft 404 (halaman kosong dengan status 200) karena Google tidak tahu bahwa ini sebenarnya halaman error, jadi terus dicrawl secara regular.

Cara Mengecek Masalah Crawl Budget

Sekarang pertanyaannya: bagaimana kalian tahu apakah website kalian punya masalah crawl budget atau tidak?

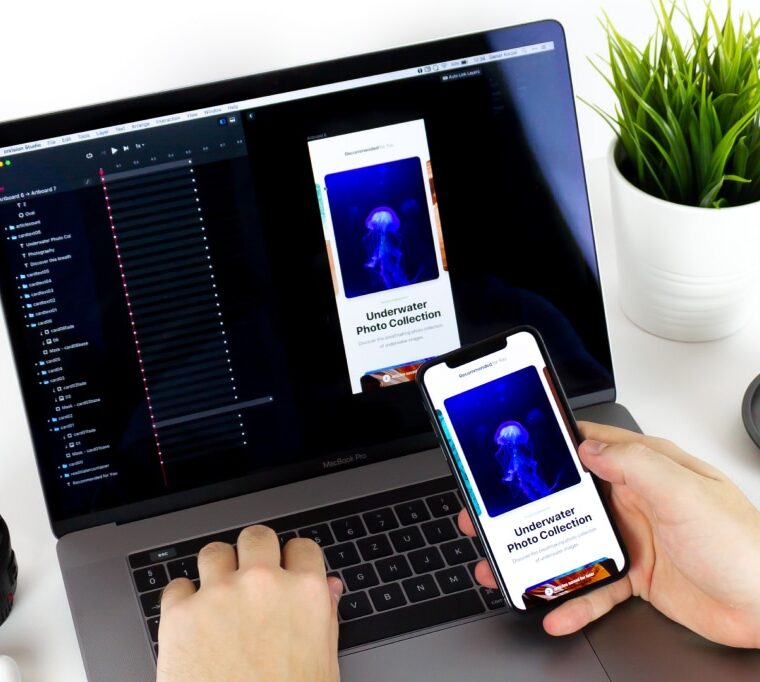

Google Search Console: Crawl Stats Report

Ini adalah tool utama yang harus kalian pelajari. Di Google Search Console, ada report khusus bernama “Crawl Stats” yang memberikan data sangat detail tentang bagaimana Googlebot crawl website kalian.

Data yang kalian dapatkan di sini termasuk:

- Response code distribution: Berapa persen request yang mengembalikan 200, 404, 301, 5xx, dll.

- File type yang dicrawl: Apakah Googlebot lebih banyak crawl HTML, CSS, JS, atau image

- Crawl purpose: Apakah untuk discovery, refresh, atau karena sitemap submission

- Googlebot type: Desktop bot vs mobile bot

Yang paling penting untuk diagnostic adalah bagian host status dan URL examples. Di host status, kalian bisa lihat average response time dan download size—kalau ini tinggi, bisa jadi sinyal bahwa server kalian jadi bottleneck. Di URL examples, kalian bisa lihat URL-URL mana yang paling sering dicrawl—dan ini sering jadi tempat kalian menemukan “kebocoran” crawl budget.

Misalnya kalau kalian lihat ribuan request ke URL filter parameter yang seharusnya tidak perlu diindex, itu red flag yang jelas.

Server log analysis (untuk tim teknis)

Kalau tim kalian punya akses ke server logs dan resource untuk menganalisisnya, ini adalah gold mine untuk diagnostic crawl budget.

Dari server logs, kalian bisa:

- Identifikasi URL pattern yang paling banyak di-hit oleh Googlebot

- Pisahkan traffic Googlebot dari bot lain (banyak bot yang mengaku sebagai Googlebot tapi sebenarnya bukan)

- Melihat pola crawling berdasarkan waktu (apakah ada spike tertentu yang tidak wajar)

Tools seperti Screaming Frog Log Analyzer atau Botify bisa sangat membantu untuk ini.

Crawl audit internal

Selain melihat bagaimana Googlebot crawl website kalian, kalian juga perlu melakukan crawl sendiri menggunakan crawler seperti Screaming Frog atau Sitebulb.

Tujuannya untuk menemukan:

- URL parameter yang menciptakan duplikasi

- Pagination yang tidak terbatas

- Template halaman yang duplikat

- Orphan pages (halaman yang tidak ter-link dari manapun)

Dari sini kalian bisa membuat prioritas: URL mana yang harus dikurangi crawl-nya, dan URL mana yang justru harus lebih sering dicrawl.

Strategi Optimasi Crawl Budget

Nah, sekarang masuk ke bagian yang paling actionable. Saya susun strategi ini dari yang paling cepat dampaknya sampai yang paling struktural.

Level 1: Quick Wins (1–2 minggu)

Kurangi error server & timeout (5xx)

Ini adalah low-hanging fruit yang bisa kalian tangani cepat. Setiap kali Googlebot mendapat error 5xx (server error), crawl rate limit bisa turun karena Google menganggap server kalian sedang bermasalah.

Audit error 5xx di Search Console dan server logs. Identifikasi pattern-nya: apakah terjadi di waktu tertentu? Di URL pattern tertentu? Apakah karena database overload atau memory limit?

Fix masalah ini dan monitoring hasilnya. Kalau server health membaik, biasanya dalam beberapa minggu crawl rate akan meningkat secara natural.

Perbaiki redirect chain dan loop

Redirect chains (A → B → C → D) dan redirect loops sangat tidak efisien untuk crawl budget. Googlebot harus melakukan multiple requests untuk sampai ke destination URL.

Audit semua redirect di website kalian dan pastikan semuanya adalah 1-hop redirect (A → B, selesai). Kalau ada redirect chains, update source URL untuk langsung mengarah ke final destination.

Stop “cache-busting parameter” untuk resource yang tidak berubah

Banyak website menambahkan version parameter ke URL resource (misalnya style.css?v=12345) untuk cache-busting. Masalahnya, kalau parameter ini berubah setiap kali build, Google menganggap ini sebagai resource baru dan crawl ulang.

Untuk resource yang jarang berubah, gunakan versioning di filename (style-v2.css) alih-alih query parameter. Ini lebih cache-friendly untuk Googlebot.

Pastikan sitemap hanya berisi URL canonical & indexable

Sitemap adalah cara kalian “mengundang” Googlebot untuk crawl URL tertentu. Tapi kalau sitemap kalian berisi URL hasil filter, parameter, atau URL yang sebenarnya di-canonical ke URL lain, ini membingungkan dan tidak efisien.

Audit sitemap dan pastikan hanya berisi URL yang memang ingin kalian index. Buang URL dengan parameter, URL yang canonical ke URL lain, atau URL yang di-noindex.

Level 2: Kontrol URL Explosion (paling sering di ecommerce Indonesia)

Ini adalah masalah paling umum yang saya temui di klien ecommerce Indonesia. Dan ini yang paling berdampak signifikan terhadap crawl budget.

Batasi kombinasi facet/filter yang bisa diakses crawler

Kalau website kalian punya faceted navigation (filter produk berdasarkan multiple attributes), kalian perlu membatasi kombinasi mana yang bisa dicrawl.

Misalnya, kalian bisa memutuskan bahwa hanya kombinasi 2 filter yang boleh diindex (contoh: warna + ukuran). Kombinasi 3 filter atau lebih (warna + ukuran + brand) harus di-canonical ke URL yang lebih simple atau di-noindex/disallow di robots.txt.

Ini bukan berarti user tidak bisa menggunakan multiple filter. Mereka tetap bisa, tapi URL kombinasi kompleks ini tidak akan dicrawl atau diindex Google.

Terapkan canonical yang konsisten

Untuk URL filter atau sorting, pastikan ada canonical tag yang konsisten mengarah ke kategori utama.

Contoh:

- URL utama: tokoonline.com/sepatu-pria

- URL dengan filter warna merah: tokoonline.com/sepatu-pria?warna=merah

- Canonical tag di URL filter harus mengarah ke: tokoonline.com/sepatu-pria

Dengan begini, Google tahu bahwa URL dengan filter adalah variasi dari URL utama dan tidak perlu dicrawl sesering URL utama.

Tangani parameter yang menghasilkan duplikasi

Parameter seperti sorting (sort=price_low), tracking (utm_source=email), atau internal search (search=sepatu) sering menghasilkan duplikasi konten yang tidak perlu dicrawl.

Kalian bisa menggunakan Google Search Console URL Parameters tool untuk memberi tahu Google bagaimana cara menangani parameter ini. Atau lebih robust lagi, gunakan canonical tag atau robots.txt untuk mengontrol crawling parameter-parameter ini.

Pastikan pagination & infinite scroll punya URL yang dapat di-crawl dengan benar

Pagination yang implement-nya salah bisa menciptakan infinite space. Misalnya kalau URL pagination bisa di-append terus menerus (page=9999999) tapi tidak ada mekanisme untuk membatasi atau mengarahkan ke halaman valid terakhir.

Pastikan pagination kalian punya:

- URL yang proper untuk setiap halaman (bukan JavaScript-only navigation)

- Rel next/prev tags (meskipun Google sudah tidak menggunakannya untuk ranking, ini tetap membantu untuk crawling)

- Mekanisme untuk membatasi pagination (kalau hanya ada 10 halaman, URL page=11 harus return 404 atau redirect ke page 10)

Level 3: Tingkatkan Crawl Efficiency (render & resource)

Kurangi resource yang dibutuhkan untuk rendering

Website modern sering butuh banyak resource untuk rendering: multiple CSS files, JavaScript libraries, fonts, images.

Semakin banyak resource yang dibutuhkan untuk rendering, semakin banyak crawl budget yang dikonsumsi. Karena Googlebot perlu crawl semua resource ini untuk bisa merender halaman dengan benar.

Optimasi yang bisa dilakukan:

- Minify dan compress CSS/JS

- Combine multiple CSS/JS files kalau memungkinkan

- Lazy load images yang tidak kritikal

- Gunakan critical CSS untuk above-the-fold content

Optimasi kecepatan server & page performance

Server yang cepat dan responsive bisa meningkatkan crawl rate limit. Karena Google melihat bahwa server kalian “sehat” dan sanggup handle traffic lebih tinggi.

Beberapa optimasi yang worth it:

- Upgrade server resource kalau memang underspec

- Implement proper caching (server-side dan browser caching)

- Optimize database queries

- Gunakan CDN untuk static assets

Hindari memindahkan resource kritikal ke hostname lain hanya demi “memindahkan beban crawl”

Ada mitos bahwa memindahkan CSS/JS ke subdomain atau CDN hostname lain bisa “menghemat” crawl budget karena resource ini tidak dihitung di main domain.

Google menjelaskan bahwa ini bukan strategi yang recommended. Karena bisa berdampak negatif ke page performance (extra DNS lookup, connection setup) yang malah bisa menurunkan crawl rate limit.

Lebih baik fokus ke optimasi resource itu sendiri (compress, minify, cache) daripada memindahkannya ke hostname lain.

Level 4: Pruning & Quality Control (mengurangi low-value URLs)

Ini adalah level yang paling struktural dan biasanya butuh effort lebih besar, tapi dampaknya sangat signifikan untuk long-term.

Identifikasi halaman tipis/duplikat dan konsolidasikan

Audit seluruh website untuk menemukan:

- Halaman dengan konten duplikat atau near-duplicate

- Halaman tipis yang tidak punya value untuk user (contoh: tag pages dengan hanya 1-2 artikel)

- Halaman yang sebenarnya bisa digabung jadi satu halaman yang lebih comprehensive

Untuk halaman-halaman ini, kalian punya beberapa opsi:

- Merge: Gabungkan jadi satu halaman yang lebih kuat

- Redirect 301: Kalau ada halaman similar yang lebih kuat, redirect ke sana

- Noindex: Kalau halaman ini tetap perlu ada untuk user tapi tidak perlu diindex

- Delete: Kalau memang tidak ada value sama sekali

Tangani soft 404 yang sering muncul di kategori kosong/out of stock

Ini sangat relevan untuk ecommerce. Kategori produk yang kosong atau halaman produk out of stock sering mengembalikan status 200 (OK) dengan konten kosong atau pesan “no products found”.

Google tetap crawl halaman-halaman ini secara regular karena tidak tahu bahwa ini sebenarnya halaman “kosong”.

Solusinya:

- Untuk produk yang temporary out of stock: biarkan status 200, tapi pastikan ada konten yang meaningful (deskripsi produk, review, notifikasi restock)

- Untuk kategori yang kosong: return 404 atau redirect ke parent category

- Untuk produk yang permanently discontinued: return 410 (Gone)

Audit hacked/spam URLs karena bisa mengganggu crawl & indexing

Kalau website pernah kena hack dan attacker membuat spam pages, Google bisa menghabiskan crawl budget untuk crawl halaman-halaman ini.

Gunakan Search Console untuk identifikasi URL yang tidak familiar (biasanya ada di Index Coverage report atau Manual Actions). Remove halaman-halaman ini dan pastikan security hole yang memungkinkan hack sudah dipatch.

Robots.txt, noindex, dan mitos yang sering salah

Ada beberapa misconception tentang penggunaan robots.txt dan noindex untuk mengontrol crawl budget. Mari kita luruskan.

“crawl-delay” di robots.txt tidak diproses Googlebot

Directive crawl-delay yang ada di robots.txt beberapa search engine (Bing, Yandex) tidak diproses oleh Googlebot. Jadi jangan mengandalkan ini untuk mengontrol crawl rate Google.

Kalau kalian memang perlu menurunkan crawl rate (misalnya karena server issue), gunakan setting di Google Search Console.

noindex untuk crawl budget: bisa membantu, tapi tidak instan

Banyak yang berpikir bahwa menambahkan noindex tag ke halaman akan langsung “mengosongkan” crawl budget yang sebelumnya terpakai untuk halaman itu.

Realitanya lebih kompleks. Google tetap perlu crawl halaman untuk melihat noindex tag-nya. Efeknya lebih ke long-term: setelah Google confirm bahwa halaman ini consistently punya noindex tag, frekuensi crawl-nya akan berkurang.

Tapi ini bukan instan. Bisa butuh beberapa minggu sampai Google “belajar” bahwa halaman ini tidak perlu dicrawl sesering sebelumnya.

Nofollow bukan alat utama untuk crawl budget

Menambahkan nofollow tag ke internal link tidak menjamin bahwa URL destination-nya tidak akan dicrawl.

Google bisa menemukan URL itu dari sumber lain: external links, sitemap, atau browsing behavior. Jadi nofollow internal link bukan cara yang reliable untuk mengontrol crawl budget.

Lebih baik gunakan robots.txt atau noindex kalau memang ingin halaman tidak dicrawl atau diindex.

Checklist Diagnostik: Kalau Crawling “Boros” di Indonesia, Biasanya Karena Ini

Berdasarkan pengalaman saya menangani klien di Indonesia, ini adalah pattern masalah yang paling sering muncul per tipe website:

Ecommerce / katalog produk

- Filter parameter & sorting menghasilkan duplikasi: Kombinasi filter warna-ukuran-brand-harga yang tidak terkontrol

- Kategori kosong/out-of-stock jadi soft 404: Halaman kategori kosong masih return 200

- Internal search pages ikut terindex/crawl: URL search results yang seharusnya noindex malah masuk index

Media / portal

- Tag archives & pagination tanpa batas: Tag pages dengan pagination yang bisa sampai ratusan halaman

- Banyak halaman tipis (author/tag) tanpa value jelas: Author pages atau tag pages yang cuma punya 1-2 artikel

Multi-language / multi-location

- Hreflang/alternate URL tidak rapi: Menciptakan banyak variasi URL yang “mirip” tapi tidak properly linked dengan hreflang

- Duplicate content di multiple language versions: Konten yang identik di multiple bahasa tanpa proper canonical atau hreflang setup

Workflow Eksekusi Tim untuk Optimasi Crawl Budget

Kalau kalian sudah identify masalah crawl budget, ini workflow yang saya sarankan untuk tim:

Step 1: Temukan “kebocoran” dari Crawl Stats

Buka Google Search Console Crawl Stats report dan fokus ke bagian URL examples. Sort berdasarkan total crawl requests dan identifikasi pattern.

Pertanyaan yang perlu dijawab:

- URL pattern mana yang paling sering dicrawl?

- Apakah URL-URL ini memang penting untuk diindex?

- Apakah ada URL dengan parameter atau filter yang tidak perlu dicrawl sesering ini?

Step 2: Putuskan treatment per pattern

Untuk setiap URL pattern yang kalian identify, putuskan strategy:

Kalau URL ini HARUS diindex dan penting:

- Perkuat internal link ke URL ini

- Pastikan ada di sitemap

- Improve konten quality

Kalau URL ini TIDAK perlu diindex:

- Gunakan canonical tag (kalau ada URL canonical yang lebih kuat)

- Atau gunakan noindex meta tag

- Atau disallow di robots.txt (kalau tidak perlu dicrawl sama sekali)

Dokumentasikan keputusan ini dalam spreadsheet untuk tracking.

Step 3: Implement → monitor 2–8 minggu

Implement perubahan secara bertahap (jangan sekaligus, agar kalian bisa isolate impact dari setiap perubahan).

Monitor di Search Console Crawl Stats:

- Apakah request volume ke URL pattern yang di-optimize berkurang?

- Apakah average response time membaik?

- Apakah distribusi crawl bergeser ke URL yang lebih penting?

Biasanya perlu 2-8 minggu untuk melihat perubahan yang signifikan, karena Googlebot perlu “belajar” pattern baru dari website kalian.

FAQ Crawl Budget

Apakah crawl budget mempengaruhi ranking?

Tidak secara langsung. Crawling adalah prerequisite agar halaman bisa muncul di hasil pencarian, tapi crawl rate bukan sinyal ranking. Artinya, meningkatkan seberapa sering Google crawl website kalian tidak otomatis meningkatkan ranking.

Yang terjadi adalah: kalau crawl budget di-optimize dengan baik, halaman-halaman penting kalian bisa lebih cepat dicrawl dan diindex saat ada update. Tapi ranking tetap ditentukan oleh kualitas konten, relevance, authority, dan ratusan faktor lainnya.

Apakah semua website perlu memikirkan crawl budget?

Tidak. Crawl budget biasanya hanya relevan untuk website besar (puluhan ribu URL ke atas), website yang sangat dinamis (sering update konten), atau website dengan struktur URL yang kompleks.

Untuk blog kecil atau company website dengan beberapa ratus halaman, crawl budget hampir tidak pernah jadi bottleneck. Fokus ke konten quality dan technical SEO dasar lebih penting.

Apakah mempercepat website menaikkan ranking lewat crawl budget?

Page speed bisa meningkatkan crawl rate (karena server lebih “sehat” dan bisa handle lebih banyak request), tapi ini tidak otomatis menaikkan ranking.

Page speed adalah ranking factor untuk mobile search, tapi impact-nya via user experience dan Core Web Vitals, bukan via crawl budget.

Jadi mempercepat website itu penting, tapi bukan karena crawl budget—lebih karena user experience dan ranking factors lainnya.

Baca juga:

- Cara Membuat Website SEO Friendly

- Pengertian SEO Off-Page, Tips dan Cara Membuat

- Cara Membangun Bisnis Online, Cocok untuk Pemula

- 13 Google Ranking Factors yang Paling Mempengaruhi SEO

Penutup

Setelah belasan tahun menjalankan Crooud dan menangani ratusan klien dari berbagai industri, saya melihat bahwa masalah crawl budget hampir selalu muncul karena tiga hal: URL explosion (terlalu banyak URL low-value yang ter-generate), masalah server/rendering (server lambat atau rendering terlalu berat), dan kurangnya kontrol atas apa yang boleh dan tidak boleh dicrawl.

Kabar baiknya, ini semua fixable. Kalian tidak perlu tool mahal atau tim besar untuk optimize crawl budget. Yang kalian butuhkan adalah pemahaman yang jelas tentang struktur website kalian, keputusan strategic tentang URL mana yang penting untuk diindex, dan eksekusi yang konsisten.

Mulai dari quick wins: fix server errors, perbaiki redirect chains, clean up sitemap. Lalu bergerak ke yang lebih struktural: kontrol URL explosion dari faceted navigation, consolidate halaman tipis, improve rendering efficiency.

Dan yang paling penting: jangan terjebak dalam optimasi crawl budget kalau masalah fundamental website kalian sebenarnya ada di tempat lain. Kalau website kalian kecil-menengah dengan struktur URL yang simple, lebih baik fokus ke content quality, internal linking, dan technical SEO fundamentals.

Crawl budget itu penting, tapi bukan segalanya.

Kalau kalian butuh bantuan untuk audit crawl budget atau optimize technical SEO website ecommerce, marketplace, atau portal yang kompleks, tim Crooud siap membantu. Reach out ke kami dan mari kita diagnose bersama.

FAQ / Related Questions

Q: Berapa lama waktu yang dibutuhkan untuk melihat hasil dari optimasi crawl budget?

Biasanya 2-8 minggu, tergantung seberapa signifikan perubahan yang kalian lakukan dan seberapa sering Googlebot crawl website kalian sebelumnya. Website besar yang sering dicrawl bisa melihat perubahan lebih cepat (2-4 minggu), sementara website yang lebih kecil mungkin butuh waktu lebih lama untuk Googlebot “belajar” pattern baru.

Q: Apakah menggunakan CDN membantu crawl budget?

CDN bisa membantu secara tidak langsung dengan meningkatkan page speed dan server response time, yang bisa meningkatkan crawl rate limit. Tapi CDN itu sendiri tidak “menghemat” crawl budget. Yang penting adalah total resource yang dibutuhkan untuk rendering halaman, bukan di mana resource itu di-host.

Q: Bagaimana cara tahu apakah website saya punya masalah crawl budget atau masalah indexing?

Check Google Search Console Coverage report. Kalau banyak halaman yang “Discovered – currently not indexed”, kemungkinan ada masalah crawl budget (Google tahu halaman ini ada tapi belum sempat crawl atau memutuskan tidak prioritas untuk crawl). Kalau halaman “Crawled – currently not indexed”, itu masalah indexing (Google sudah crawl tapi memutuskan tidak index karena quality, duplicate, atau alasan lain). Dua masalah yang berbeda, butuh solusi yang berbeda.

Q: Apakah ada cara untuk “memaksa” Google crawl halaman tertentu lebih sering?

Tidak ada cara untuk “memaksa” dalam artian yang sesungguhnya, tapi ada cara untuk encourage: submit URL via URL Inspection tool di Search Console (untuk one-off crawl request), pastikan halaman ini ter-link dengan baik dari homepage atau halaman penting lainnya (internal linking structure yang kuat), masukkan dalam sitemap dan update lastmod date saat ada perubahan signifikan. Tapi keputusan final tetap di Google berdasarkan crawl demand yang mereka calculate.

Q: Apakah crawl budget berbeda untuk Googlebot desktop vs mobile?

Ya, ada allocation yang terpisah. Tapi dengan mobile-first indexing yang sudah full rollout, Googlebot mobile biasanya lebih aktif crawl dibanding desktop. Jadi pastikan mobile version website kalian accessible dan tidak ada konten yang hidden atau blocked untuk mobile bot.

Q: Kalau saya punya multi-language website, apakah setiap language version punya crawl budget sendiri?

Tidak persis seperti itu. Crawl budget dihitung per hostname/domain. Jadi kalau kalian punya multi-language dalam satu domain (example.com/en/, example.com/id/), semuanya share crawl budget yang sama. Kalau setiap bahasa di subdomain terpisah (en.example.com, id.example.com), masing-masing punya allocation sendiri karena dianggap hostname yang berbeda.